近日,斯坦福大学人本AI研究院(HAI)发布2026年度AI指数报告,横跨技术能力、投资格局、劳动力影响、公众情绪与全球政策等维度,是迄今为止最全面的AI年度体检报告。

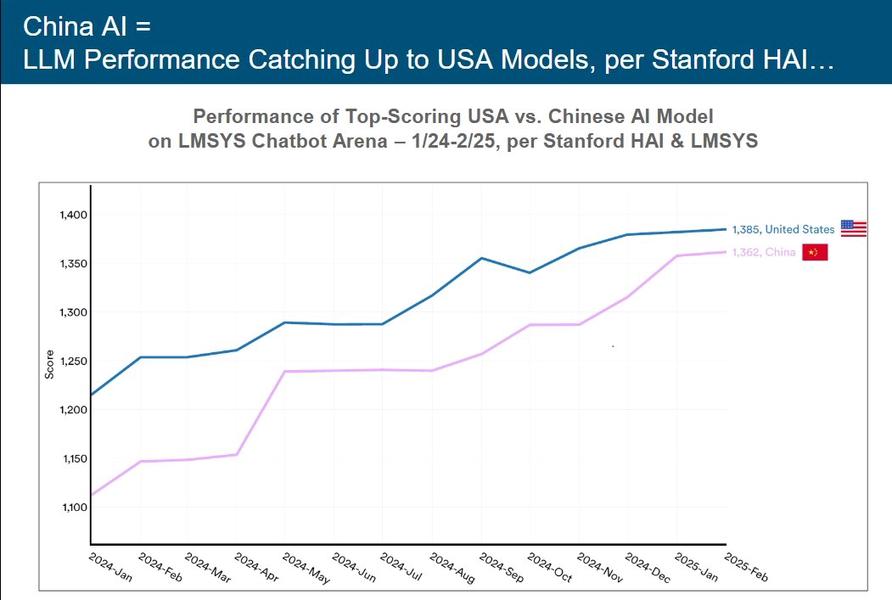

美国领先幅度从2023年的18%收窄至2026年3月的仅2.7%。2025年2月DeepSeek-R1一度与美国顶尖模型并驾齐驱,中美两国模型多次互换榜首。

值得注意的是,这2.7%的差距主要体现在综合能力榜单上,而在数学推理、代码生成等垂直维度,中国模型已多次夺冠。

报告还指出,中国顶尖模型的“参数效率”(即单位算力产出的能力)已显著优于美国同类模型,这直接说明DeepSeek式的“低成本高效能”路线并非偶然,而是一种可复制的系统性优势。差距收窄意味着美国靠堆算力拉开差距的窗口期,正在快速关闭。

2025年美国发布50个“顶尖”模型,中国约30个;来自学术和政府的仅7个,工业界贡献超90%。

报告显示,顶尖模型的训练成本中位数已突破1亿美元,高校根本无力参与竞赛,这意味着AI前沿研究的“公共品属性”正在消失。与此同时,开源模型在顶尖榜单中的占比从2023年的约35%下滑至2025年的不足20%,AI商业机密化趋势显著。这与透明度骤降的数据相互印证。

22–25岁软件开发者就业自2024年以来下降近20%,而年长同事的岗位数量却保持增长或稳定。客服等高AI暴露岗位出现相同趋势。

报告给出的解释是,年长开发者岗位稳定,并不是因为他们“经验更丰富”,而是因为他们承担的工作更多涉及系统架构、跨团队协作与技术决策,这些恰好是当前AI最难替代的部分。

真正被压缩的是“初级执行层”:写基础功能代码、做单元测试、处理文档,这些曾经是新人积累经验的必经之路。AI正在堵死这条通道,导致行业出现一个新的结构性矛盾:既缺少有经验的高级工程师,又消化不了大量初级人才。

2025年全球AI企业投资达5817亿美元,同比增长130%;美国以2859亿美元领跑,是第二名中国124亿美元的23倍。

这23倍的投资差距和2.7%的能力差距放在一起,产生了一个耐人寻味的剪刀差。它说明中国在极低的资本密度下实现了极高的能力产出。

美国的资本优势正在向基础设施层倾斜,微软、谷歌、亚马逊、Meta四家公司2025年资本开支合计超过3200亿美元,主要用于数据中心与自研芯片。底层的算力基建密度是国内企业目前最难追赶的部分。

但同时也可以看出来,中国资本更趋理性且务实,转向了垂直领域私有化部署和硬件集成(如人形机器人)。美国是在买“未来的门票”,中国是在买“当下的效率工具”。

训练Grok4的估算碳排放达72,816吨CO₂当量,相当于1.7万辆汽车行驶一年的排放量;AI数据中心总功率已达29.6GW。

报告特别指出,AI能耗增长与可再生能源部署之间存在严重的时间错位。当前主流数据中心的绿电比例平均不足30%,而AI算力需求的年增速超过60%。更棘手的是推理侧的隐性消耗:一次GPT-4级别的对话消耗的电力约为普通搜索的10倍,随着生成式AI日活用户破亿,推理端的碳排放总量已开始追上训练端。这意味着“训练一次、推理百亿次”的商业模式,其环境代价远比行业公开的数字更大。

“算力能源化”已成定局。2025年起,谷歌、亚马逊等巨头纷纷重启核能/SMR(小型核反应堆)计划,AI的天花板不再是算法,而是物理层面的电力分配。未来,“绿色算力占比”将成为衡量一个模型是否具备可持续商业价值的核心指标。

生成式AI在三年内达到53%的人口普及率,速度超过PC和互联网;美国消费者年度价值估算高达1720亿美元。

生成式AI正在像自来水一样渗入日常流程,导致社会对“低智内容”的容忍度骤降。普及率超过50%,AI也就成了“数字化平民”的生存红线。不会用AI的人,其单位时间创造的价值将不足以覆盖其生存成本。

在已采用生成式AI的用户中,每周使用频率超过5次的“重度用户”比例不足20%,大量用户仍停留在“偶尔试玩”阶段。1720亿美元的消费者价值估算,其实是基于“时间节省×时薪”的模型测算,而非实际付费规模。真实的消费者付费市场远比这个数字小得多。普及率的数字好看,但从“使用”到“依赖”再到“付费”,这条转化漏斗还远没有打通。

基础模型透明度指数平均分从去年的58点骤降至40点;95个顶尖模型中80个未公开训练代码。

透明度下降的推手是商业护城河的构建。随着模型性能趋同,训练数据(Data Recipe)成了唯一的壁垒。这种“黑盒化”不仅带来了伦理风险,更潜藏着“偏见投毒”的可能,全球开发者正在基于一套自己都不完全理解其底层逻辑的代码构建社会。

报告点名了少数几个逆势而行的异类:得分最高的是法国Mistral和部分开源社区模型,而GPT-4o、Gemini Ultra、Claude 3系列的透明度得分均低于行业中位数。值得关注的是,透明度下滑最快的维度不是”技术架构”,而是”训练数据来源”超过70%的顶尖模型拒绝披露任何关于训练语料的具体信息。这直接关联到当前全球正在爆发的版权诉讼潮,数据不透明将是一颗定时法律炸弹。

AI处理线%;但最好的模型读取表盘时间的准确率仅50%,家用机器人家务完成率仅12%。

这种不均衡揭示的是AI能力的本质结构。AI在“符号操作”层面谈球吧官方网站(写作、代码、推理)已接近或超越人类,但在“物理感知-动作闭环”层面仍处于蹒跚学步阶段。读不准表盘、做不了家务,背后是AI缺乏真正的空间推理与连续决策能力。未来的大机会在“端到端物理交互算法”。

这也是具身智能(Embodied AI)成为2025年资本新热点的直接原因。报告预测,这一能力鸿沟至少需要5–8年才能系统性弥合,意味着“AI替代体力劳动”的叙事,在本十年内大概率仍是预期大于现实。

流入美国的AI学者数量与2017年相比下降了89%,仅过去一年就骤降80%。

骤降80%的背谈球吧官方网站后,有两股力量同时在发挥作用。一是“推力”:特朗普政府的签证收紧与移民政策不确定性,让大量来自中国、印度的顶尖研究生开始重新评估赴美风险;二是“拉力”:欧洲、加拿大、阿联酋正在以大规模签证绿色通道和直接安家补贴主动抢人。

报告指出,2025年仅加拿大就发放了超过2000份AI研究人员专项居留许可。更讽刺的是,美国本土AI博士的培养速度并未加快。美国正在同时失去“引进”和“自培”两条人才通道。

全球59%的人对AI持乐观态度;但美国公众对政府监管AI的信任度仅31%,为全球最低;仅33%的美国人认为AI会改善工作,低于全球均值的40%。

对比数据更能说明问题:印度和印度尼西亚对AI改善工作的乐观比例分别高达78%和74%,非洲多国超过65%。这些恰恰是AI渗透率较低、历史技术落差较大的地区。

也就是说,越是还没有被AI“冲到”的地方,对AI越乐观;越是身处AI变革漩涡中心的人群,越感到焦虑与不信任。美国31%的政府监管信任度,折射的不只是对AI的态度,更是过去十年社交媒体监管失败留下的制度性创伤。

尽管公众认可AI的提效能力,但极度担忧AI利润流向极少数科技寡头,而风险(如失业、假消息)却由全社会承担。“AI普惠化”能否落地,将是决定未来十年社会稳定的核心因素。

对中国企业而言:2.7%的微弱差距意味着中国已经具备了在“第一梯队”掰手腕的实力,未来的胜负手在于商业化落地速度与国产算力自主化。

对个体而言:传统的“写代码”技能正在迅速贬值。如果你是22-25岁的开发者,必须迅速转型为“AI驱动型架构师”,学会指挥AI Agent来完成任务,而不是去和AI比拼码字速度。

对社会而言:透明度的下降意味着AI安全与伦理风险正在失控。当85%的顶尖模型都是“黑盒”时,全球监管面临的挑战达到了巅峰。

这份报告的数据过于真实,甚至有点残酷,它是我们每个人的AI时代生存预警。AI的能力曲线在垂直上升,而人类理解、测量和管理它的能力却近乎水平。

你如何看待2.7%的差距以及年轻开发者面临的困境?对AI的发展感到焦虑还是乐观?返回搜狐,查看更多